Wenn Sie einen Blog oder eine Website in WordPress erstellen, wird automatisch eine robots.txt-Datei für jede Ihrer Landingpages und Posts erstellt. Dies ist ein wichtiger Aspekt der SEO Ihrer Website, da er von Suchmaschinen beim Crawlen des Inhalts Ihrer Website verwendet wird.

Wenn Sie die SEO Ihrer Website auf die nächste Stufe heben möchten, ist die Optimierung der robots.txt-Datei auf Ihrer WordPress-Site wichtig, aber leider nicht so einfach wie das Hinzufügen von Schlüsselwörtern zu Ihren Inhalten. Aus diesem Grund haben wir diesen Leitfaden zu WordPress robots.txt zusammengestellt, damit Sie ihn perfektionieren und Ihr Suchranking verbessern können.

Was ist eine Robots.txt-Datei?

Beim Platzieren von Websites auf Suchmaschinen-Ergebnisseiten (SERPs) „crawlen“ Suchmaschinen wie Google Website-Seiten und analysieren deren Inhalt. Die robots.txt-Datei jeder Website teilt den „Bots“ des Crawlers mit, welche Seiten gecrawlt werden sollen und welche nicht – im Wesentlichen eine Form von Robotische Prozessautomatisierung (RPA).

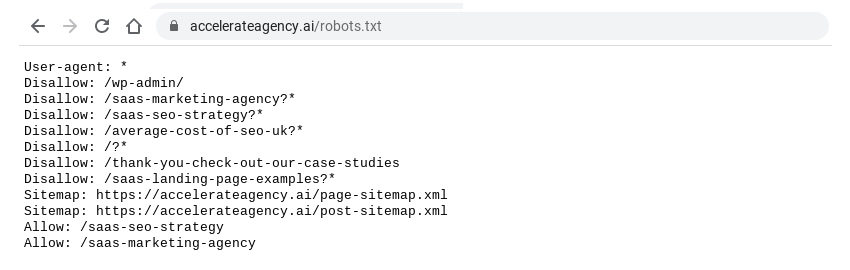

Sie können die robots.txt-Datei jeder Website anzeigen, indem Sie /robots.txt nach dem Domainnamen eingeben. Es wird ungefähr so aussehen:

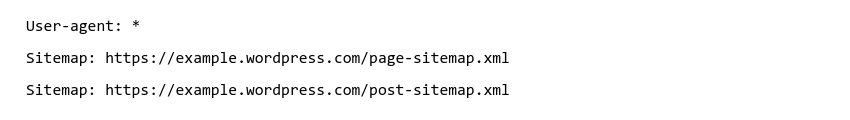

Lassen Sie uns jedes der Elemente im obigen Bild aufschlüsseln.

User-Agent

Der User-Agent in einer robots.txt-Datei ist die Suchmaschine, von der die robots.txt-Datei gelesen werden soll. Im obigen Beispiel ist der User-Agent mit einem Sternchen gekennzeichnet, dh er gilt für alle Suchmaschinen.

Die meisten Websites freuen sich, wenn alle Suchmaschinen ihre Website crawlen, aber manchmal möchten Sie möglicherweise alle Suchmaschinen außer Google daran hindern, Ihre Website zu crawlen, oder spezifische Anweisungen zum Crawlen Ihrer Website durch Suchmaschinen wie Google News oder Google Bilder bereitstellen.

In diesem Fall müssen Sie die User-Agent-ID der Suchmaschinen ermitteln, die Sie anweisen möchten. Dies ist einfach genug, um online zu finden, aber hier sind einige der wichtigsten:

- Google: Googlebot

- Google News: Googlebot-News

- Google Bilder: Googlebot-Image

- Google Video: Googlebot-Video

- Bing: Bingbot

- Yahoo: Schlürfen Bot

Zulassen und nicht zulassen

In robots.txt-Dateien teilen Zulassen und Verbieten den Bots mit, welche Seiten und Inhalte sie crawlen können und welche nicht. Wenn Sie, wie oben erwähnt, alle Suchmaschinen außer Google daran hindern möchten, Ihre Website zu crawlen, können Sie die folgende robots.txt-Datei verwenden:

Der Schrägstrich (/) nach „Disallow“ und „Allow“ teilt dem Bot mit, dass er alle Seiten crawlen darf oder nicht. Sie können auch bestimmte Seiten zwischen Schrägstriche setzen, um dem Bot zu erlauben oder zu verbieten, sie zu crawlen.

Seitenverzeichnis

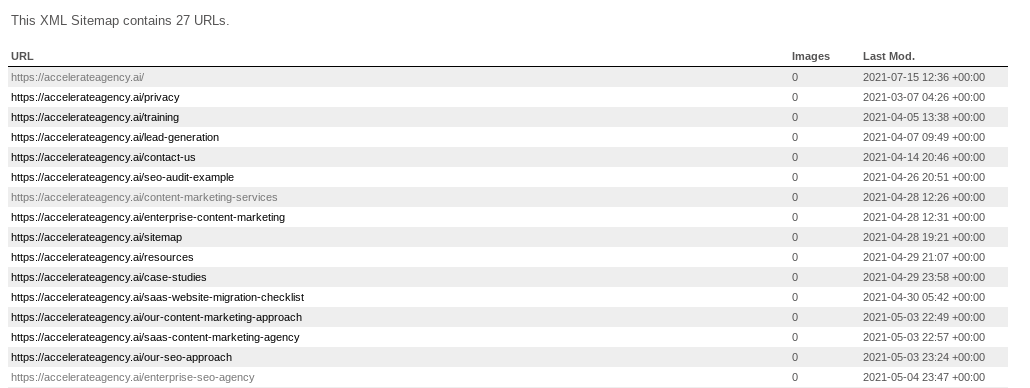

Die „Sitemap“ in einer robots.txt-Datei ist eine XML-Datei, die eine Liste und Details aller Seiten Ihrer Website enthält. Es sieht aus wie das:

Die Sitemap enthält alle Webseiten, die der Bot entdecken soll. Die Sitemap ist besonders hilfreich, wenn Sie Webseiten haben, die in den Suchergebnissen erscheinen sollen, es sich aber nicht um typische Landingpages handelt – wie zum Beispiel Blog-Posts.

Sitemaps sind besonders wichtig für WordPress-Benutzer, die hoffen, dass beleben ihre Website mit Blog-Posts und Kategorieseiten. Viele davon erscheinen möglicherweise nicht in SERPs, wenn sie keine eigene robots.txt-Sitemap haben.

Dies sind die Kernaspekte einer robots.txt-Datei. Es sollte jedoch beachtet werden, dass Ihre robots.txt-Datei kein todsicherer Weg ist, um Suchmaschinen-Bots daran zu hindern, bestimmte Seiten zu crawlen. Zum Beispiel, wenn eine andere Website . verwendet Ankertexte um auf eine Seite zu verlinken, die Sie in Ihrer robots.txt-Datei „nicht zugelassen“ haben, können Suchmaschinen-Bots diese Seite trotzdem crawlen.

Benötigen Sie eine Robots.txt-Datei auf WordPress?

Wenn Sie eine mit WordPress betriebene Website oder einen Blog haben, verfügen Sie bereits über eine automatisch generierte robots.txt-Datei. Hier sind einige Gründe, warum es wichtig ist, Ihre robots.txt-Datei zu berücksichtigen, wenn Sie sicherstellen möchten, dass Sie eine SEO-freundliche WordPress-Site haben.

Sie können Ihr Crawl-Budget optimieren

Ein Crawl-Budget oder eine Crawl-Quote ist die Anzahl der Seiten, die Suchmaschinen-Bots an einem bestimmten Tag auf Ihrer Website crawlen. Wenn Sie keine optimierte robots.txt-Datei haben, verschwenden Sie möglicherweise Ihr Crawl-Budget und verhindern, dass Bots die Seiten Ihrer Website crawlen, die in den SERPs zuerst erscheinen sollen.

Wenn Sie Produkte oder Dienstleistungen über Ihre WordPress-Site verkaufen, möchten Sie idealerweise die Seiten mit den besten Umsatzumwandlung von Crawler-Bots priorisiert werden.

Sie können Ihre wichtigen Landing Pages priorisieren

Durch die Optimierung Ihrer robots.txt-Datei können Sie sicherstellen, dass die Zielseiten, die in SERPs zuerst erscheinen sollen, für Crawler-Bots einfach und schnell zu finden sind. Die Aufteilung Ihres Site-Index in einen ‚Pages‘- und ‚Posts‘-Index ist hierfür besonders nützlich, da Sie sicherstellen können, dass Blog-Posts in SERPs und nicht nur in Ihren Standard-Landingpages erscheinen.

Wenn Ihre Website beispielsweise viele Seiten hat und Ihr Kundendaten zeigt, dass Ihre Blog-Posts viele Käufe generieren, können Sie Sitemaps in Ihrer robots.txt-Datei verwenden, um sicherzustellen, dass Ihre Blog-Posts auf SERPs erscheinen.

Sie können die allgemeine SEO-Qualität Ihrer Website verbessern

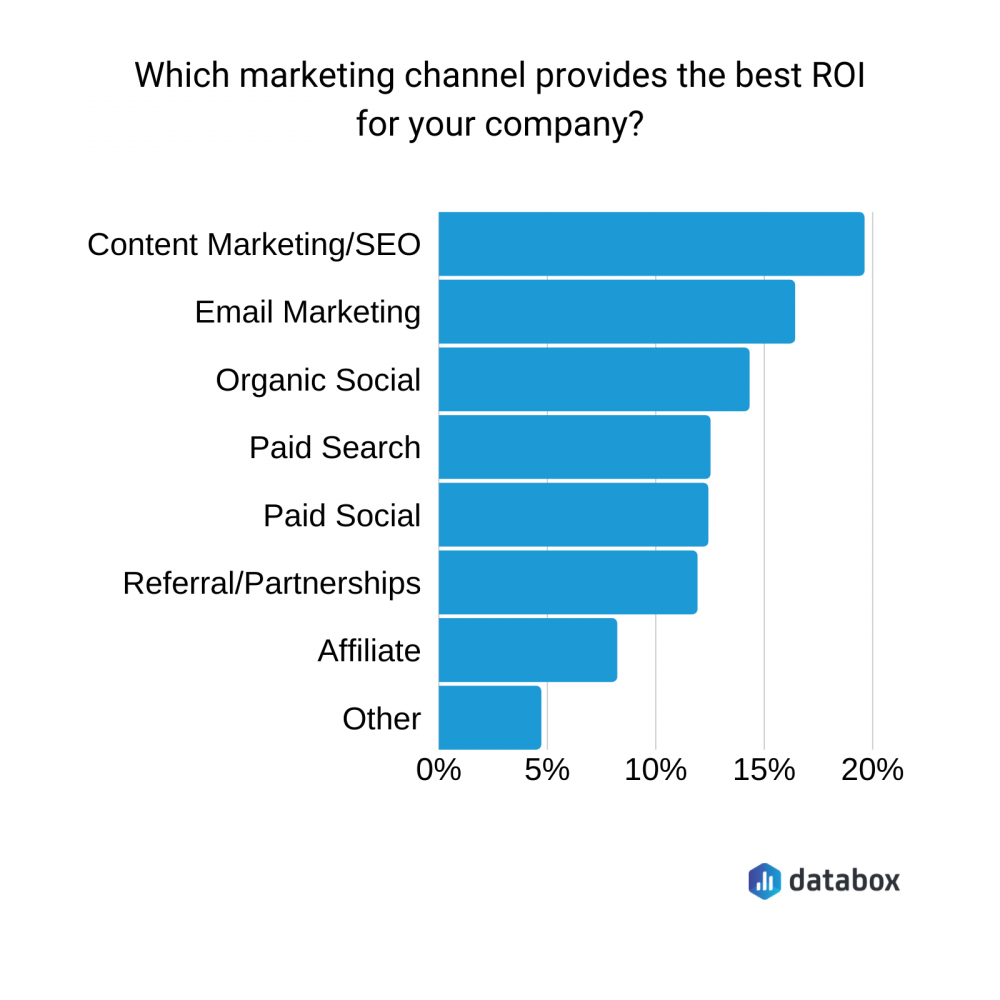

Vermarkter sind sich des Großen bewusst Suchmaschinenoptimierung ROI. Organische Suchanfragen auf Ihre Website zu lenken, indem Sie sich auf die SEO konzentrieren, ist billiger und oft effektiver als bezahlte Anzeigen und Affiliate-Links – obwohl beide immer noch helfen. Sehen Sie sich diese Statistiken an für ROI des Marketingkanals.

Die Optimierung Ihrer robots.txt-Datei ist nicht die einzige Möglichkeit, das Suchranking Ihrer Website oder Ihres Blogs zu verbessern. Sie benötigen weiterhin SEO-freundliche Inhalte auf den Seiten selbst, die Sie möglicherweise benötigen SEO SaaS Anbieter zu helfen. Sie können Ihre robots.txt-Datei jedoch ganz einfach selbst bearbeiten.

So bearbeiten Sie eine Robots.txt-Datei in WordPress

Wenn Sie Ihre robots.txt-Datei in WordPress bearbeiten möchten, gibt es mehrere Möglichkeiten, dies zu tun. Die beste und einfachste Möglichkeit besteht darin, Ihrem Content-Management-System ein Plugin hinzuzufügen – Ihrem WordPress-Dashboard.

Fügen Sie Ihrem WordPress ein SEO-Plugin hinzu

Dies ist der einfachste Weg, um Ihre WordPress robots.txt-Datei zu bearbeiten. Es gibt viele gute SEO-Plugins, mit denen Sie die robots.txt-Datei bearbeiten können. Einige der beliebtesten sind Yoast, Rank Math und All In One SEO.

Fügen Sie Ihrem WordPress ein Robots.txt-Plugin hinzu

Es gibt auch WordPress-Plugins, die speziell durch Bearbeiten Ihrer robots.txt-Datei entwickelt wurden. Beliebte robots.txt-Plugins sind Virtual Robots.txt, WordPress Robots.txt Optimization und Robots.txt Editor.

So testen Sie Ihre WordPress Robots.txt-Datei

Wenn Sie Ihre robots.txt-Datei bearbeitet haben, ist es wichtig, dass Sie sie testen, um sicherzustellen, dass Sie keine Fehler gemacht haben. Fehler in Ihrer robots.txt-Datei können dazu führen, dass Ihre Website vollständig von SERPs ausgeschlossen wird.

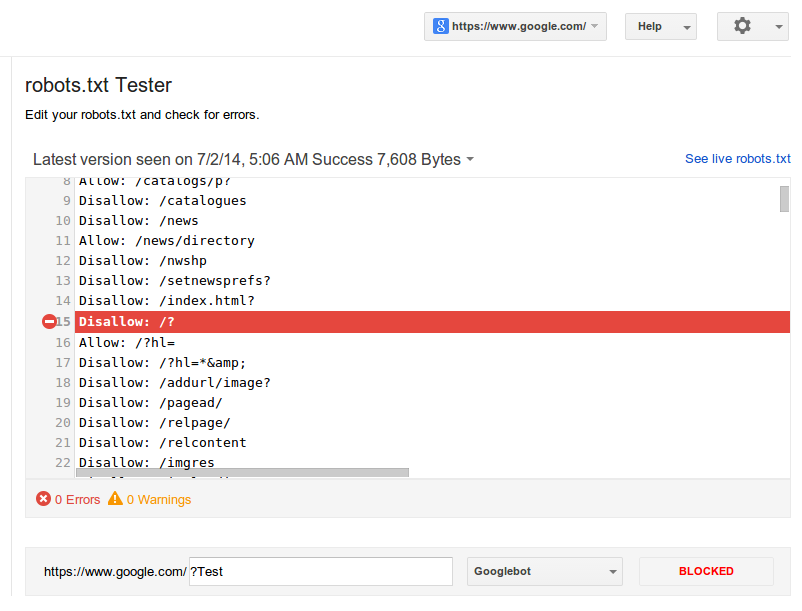

Google Webmaster hat ein robots.txt-Testtool die Sie kostenlos verwenden können, um Ihre Datei zu testen. Um es zu verwenden, fügen Sie einfach die URL Ihrer Homepage hinzu. Die Datei robots.txt wird angezeigt und Sie sehen „Syntaxwarnung“ und „Logikfehler“ in allen Zeilen der Datei, die nicht funktionieren.

Sie können dann eine bestimmte Seite Ihrer Website aufrufen und einen User-Agent auswählen, um einen Test durchzuführen, der zeigt, ob diese Seite „akzeptiert“ oder „gesperrt“ ist. Sie können Ihre robots.txt-Datei im Testtool bearbeiten und den Test bei Bedarf erneut ausführen. Beachten Sie jedoch, dass dies Ihre eigentliche Datei nicht ändert. Sie müssen die bearbeiteten Informationen kopieren und in Ihren robots.txt-Editor einfügen und dort speichern.

So optimieren Sie Ihre WordPress Robots.txt-Datei für SEO

Der einfachste Weg, Ihre robots.txt-Datei zu optimieren, besteht darin, auszuwählen, welche Seiten Sie nicht zulassen möchten. In WordPress sind typische Seiten, die Sie möglicherweise nicht zulassen, /wp-admin/, /wp-content/plugins/, /readme.html, /zurückverfolgen/.

Zum Beispiel a SaaS-Marketing Anbieter hat viele verschiedene Seiten und Beiträge auf ihrer WordPress-Site. Durch das Sperren von Seiten wie /wp-admin/ und /wp-content/plugins/, können sie sicherstellen, dass die von ihnen geschätzten Seiten von Crawler-Bots priorisiert werden.

Erstellen Sie Sitemaps und fügen Sie sie Ihrer Robots.txt-Datei hinzu

WordPress erstellt eine eigene generische Sitemap, wenn Sie damit einen Blog oder eine Website erstellen. Diese finden Sie normalerweise unter example.wordpress.com/sitemap.xml. Wenn Sie Ihre Sitemap anpassen und zusätzliche Sitemaps erstellen möchten, sollten Sie ein robots.txt- oder SEO-WordPress-Plugin verwenden.

Sie können auf Ihr Plugin in Ihrem WordPress-Dashboard zugreifen und es sollte einen Abschnitt zum Aktivieren und Bearbeiten Ihrer Sitemap enthalten. Mit guten Plugins können Sie problemlos zusätzliche Sitemaps erstellen und anpassen, z. B. eine Sitemap für „Seiten“ und eine Sitemap für „Posts“.

Wenn Ihre Sitemaps eingerichtet sind, fügen Sie sie einfach wie folgt zu Ihrer robots.txt-Datei hinzu:

Nehmen Sie einen minimalistischen Ansatz

Auch wenn es spannend sein kann, Ihre WordPress robots.txt-Datei zu bearbeiten und zu optimieren, ist es wichtig, einen minimalistischen Ansatz zu verfolgen, bei dem weniger ist mehr. Dies liegt daran, dass wenn Sie Seiten auf Ihrer Website nicht zulassen, dies verhindert, dass Crawler-Bots diese Seiten nach anderen Seiten durchsuchen. Dies kann bedeuten, dass wichtige Seiten nicht entdeckt werden und die strukturelle Integrität Ihrer Website aus Sicht von Suchmaschinen-Bots geschwächt wird.

Es ist auch nicht erforderlich, den Zugriff auf jede Seite Ihrer Website in der robots.txt-Datei zu „erlauben“. Crawler-Bots entdecken diese Seiten bereits – konzentrieren Sie sich stattdessen auf Ihre Sitemaps und die Seiten, die Sie nicht zulassen müssen, damit Ihre wichtigsten Seiten zuerst gefunden werden.

In diesem Handbuch haben wir alles, was Sie über WordPress robots.txt-Dateien wissen müssen, bereitgestellt. Von der Erklärung, was robots.txt-Dateien sind, bis hin zu den Gründen und wie Sie Ihre robots.txt-Datei für SEO optimieren sollten, hilft dieser Artikel, wenn Sie einfache und effektive Möglichkeiten finden möchten, das Suchranking Ihrer WordPress-Website zu verbessern.